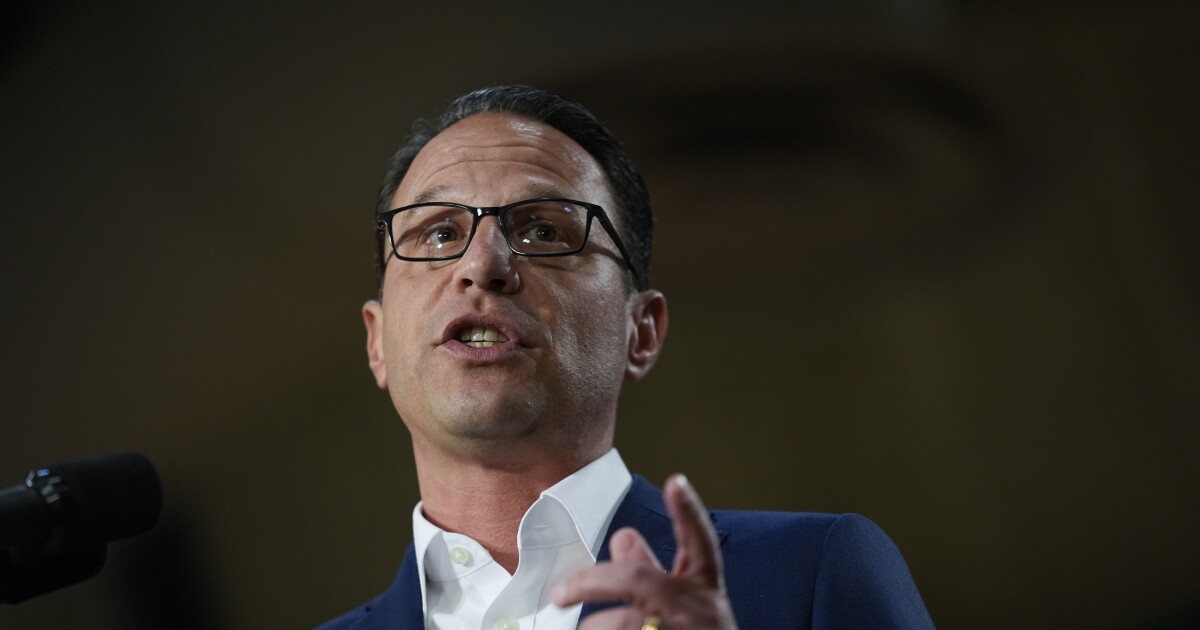

Gouverneur Josh Shapiro heeft een chatbotmaker voor kunstmatige intelligentie aangeklaagd, omdat zijn chatbots zich illegaal voordoen als artsen en de gebruikers van het systeem misleiden door te denken dat ze medisch advies krijgen van een erkende professional.

De rechtszaak, die vrijdag is ingediend, vraagt de Commonwealth Court over de hele staat om Character Technologies Inc., het bedrijf achter Character.AI, te gelasten zijn chatbots te stoppen “zich bezig te houden met de onwettige praktijk van geneeskunde en chirurgie.”

In de rechtszaak stond dat een onderzoeker van het staatsagentschap dat licenties verleent aan professionals een account had aangemaakt op Character.AI, op het woord ‘psychiatrie’ had gezocht en een groot aantal karakters had gevonden, waaronder één die werd beschreven als een ‘dokter in de psychiatrie’.

Dat personage stelde zichzelf voor als in staat om de onderzoeker te beoordelen “als een arts” die een vergunning heeft in Pennsylvania, aldus de rechtszaak.

“Pennsylvaniërs verdienen het om te weten met wie – of wat – ze online omgaan, vooral als het om hun gezondheid gaat”, zei Shapiro in een verklaring. “We zullen niet toestaan dat bedrijven AI-tools inzetten die mensen misleiden door te geloven dat ze advies krijgen van een erkende medische professional.”

Een woordvoerder van Character.AI weigerde commentaar te geven op de rechtszaak, maar zei in een verklaring per e-mail: “Onze hoogste prioriteit is de veiligheid en het welzijn van onze gebruikers.

“De door gebruikers gemaakte personages op onze site zijn fictief en bedoeld voor entertainment en rollenspellen”, vervolgde de verklaring. “We hebben robuuste stappen ondernomen om dat duidelijk te maken, inclusief prominente disclaimers in elke chat om gebruikers eraan te herinneren dat een personage geen echte persoon is en dat alles wat een personage zegt als fictie moet worden behandeld. Ook voegen we robuuste disclaimers toe die duidelijk maken dat gebruikers niet op personages moeten vertrouwen voor welk soort professioneel advies dan ook.”

Ongeveer een derde van de volwassenen heeft zich tot AI-chatbots gewend voor gezondheidsinformatie. volgens een KFF-enquête. Maar onderzoekers “leren nog steeds als vakgebied wat de effecten van het chatten met deze bots (zullen zijn)”, zegt Dr. John Torous, een psychiater en voorzitter van de nieuw opgerichte Council on Digital Health, Innovation and Technology van de American Psychiatric Association. “We hebben aan het uiterste einde gezien dat deze bots in verband kunnen worden gebracht met sterfgevallen door zelfmoord.”

“Voor veel mensen weten we niet wat er gebeurt” als ze een chatbot om advies vragen over een geestelijk of lichamelijk gezondheidsprobleem, zegt Torous. “Geeft het juist advies? Geeft het onjuist advies? Vertelt het mensen dat ze met de behandeling moeten stoppen?”

Character.AI heeft te maken gehad met verschillende rechtszaken over de veiligheid van kinderen. In januari kwamen Google en Character Technologies overeen een rechtszaak te schikken van een moeder uit Florida die beweerde dat een chatbot haar tienerzoon ertoe had aangezet zelfmoord te plegen. Afgelopen herfst verbood Character.AI minderjarigen om zijn chatbots te gebruiken, vanwege de groeiende bezorgdheid over de effecten van kunstmatige intelligentie-gesprekken op kinderen.

Ambtenaren zeiden dat de zaak in Pennsylvania “de eerste in zijn soort” is waarin wordt geprobeerd beperkingen op te leggen aan AI door te stellen dat het de regels voor professionele licentieverlening heeft geschonden.

Te midden van de richtlijn van de regering-Trump om “administratieve rompslomp en lastige regelgeving wegnemen“Over de ontwikkeling van AI en het ontbreken van consensus in het Congres hebben staten grotendeels de taak op zich genomen om richtlijnen te creëren rond de veiligheid van kinderen en technologische transparantie, zegt Ashley London, universitair hoofddocent rechten aan de Kline School of Law van Duquesne University.

Rechtszaken die in andere staten zijn aangespannen, hebben zich geconcentreerd op de schendingen van de consumentenbescherming die mogelijk door AI worden veroorzaakt. A onlangs een Kentucky-rechtszaak ingediend beweert dat Character.AI kinderen blootstelt aan seksueel gedrag, kindermisbruik en zelfbeschadiging, en daarmee de Kentucky Consumer Protection Act en andere wetten overtreedt.

De Algemene Vergadering van Pennsylvania en andere staatswetgevers hebben ook geprobeerd AI-bedrijven en chatbots te reguleren (hoewel veel van de inspanningen van Pennsylvania nog steeds in commissie).

“AI kan natuurlijk heel nuttig zijn”, zei Londen. Maar zonder vangrails ‘ben je echt overgeleverd aan de genade van het bedrijf en de ontwikkelaars, wier doel het is om geld te verdienen voor de aandeelhouders, punt uit.’

Hoewel de site servicevoorwaarden zegt Character.AI kan niet aansprakelijk worden gesteld voor de inhoud – accuraat of niet – die wordt geproduceerd door de door AI gegenereerde chats. Het zal waarschijnlijk aan de Commonwealth Court zijn om te bepalen of dat enig gewicht heeft. Ze voegde eraan toe: “We zullen veel interessante juridische belangen zien die in feite tegenstrijdig kunnen zijn.”